はじめに

8月から約1ヶ月の間、AIスペシャリストコースのインターンシップに参加した兵藤です。普段は音声変換や音声合成の研究をしたり、競技プログラミングをやったりしています。

本記事では、私がインターンシップで取り組んだクロスリンガル声質変換技術の研究開発について紹介します。

本記事の概要

はじめに声質変換・クロスリンガル声質変換について説明し、デモを交えながら変換の概要を紹介します。次に、事前学習済みモデルを応用したクロスリンガル声質変換システムを紹介します。

声質変換とは

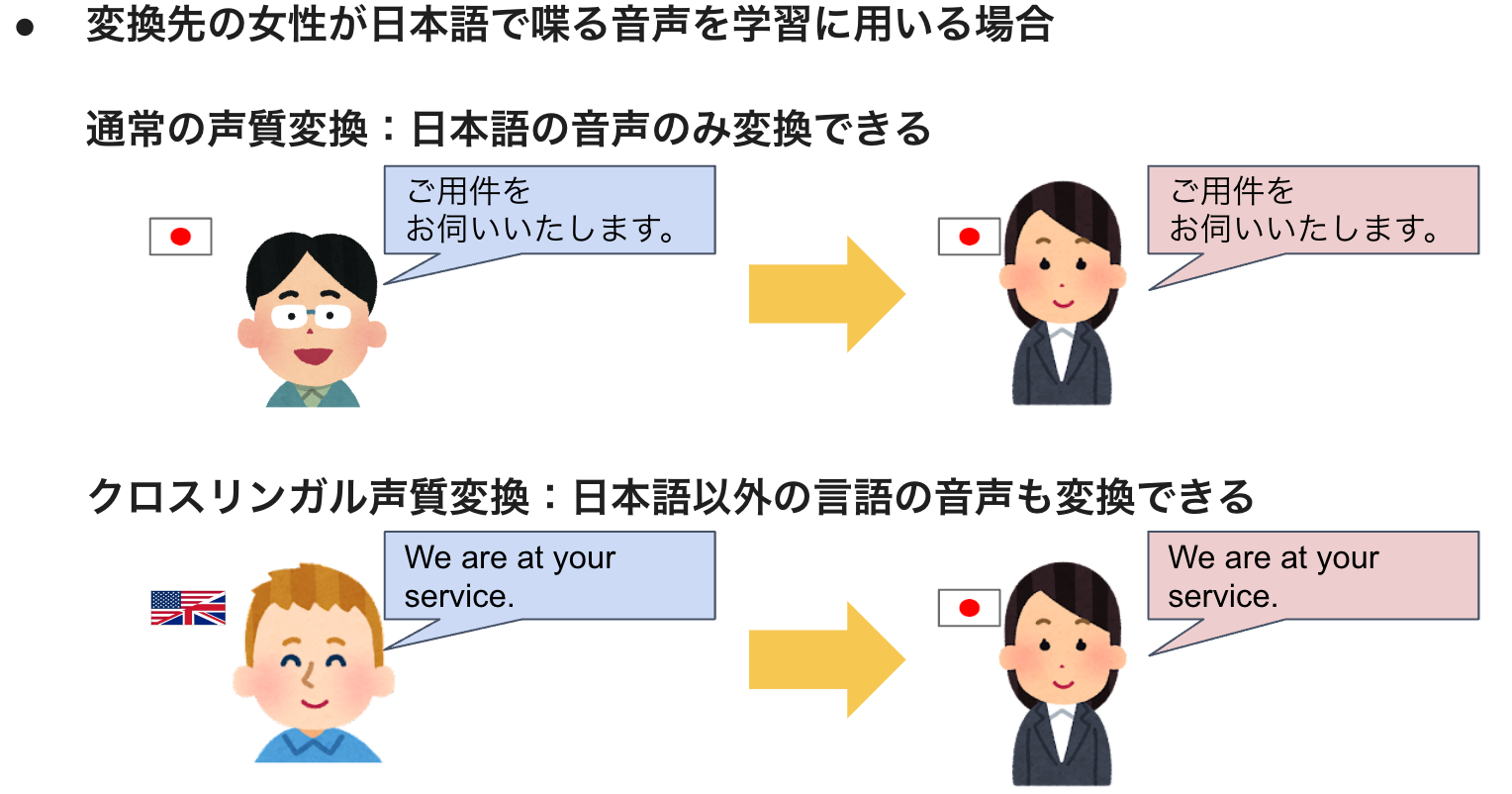

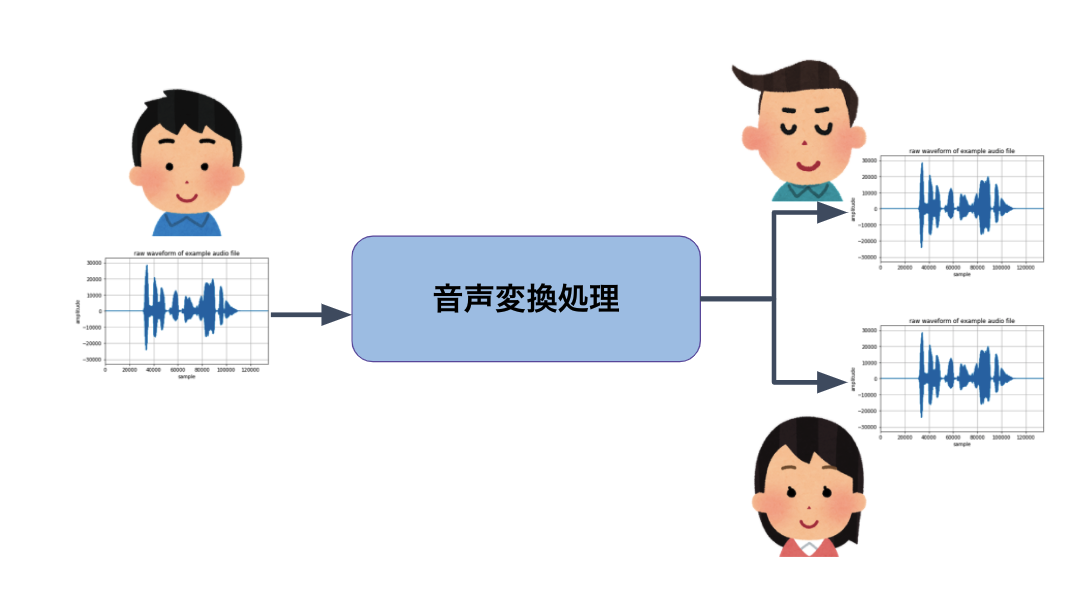

声質変換(Voice Conversion)とは、音声の言語情報や喋り方を保ったまま、声質を別人のそれに変換した音声を生成する技術です。例えば以下のように、男性の音声を女性の音声に変換することができます。

入力音声(from Voice Conversion Challenge 2020 database , which is made available here under the Open Database License (ODbL).)

変換した音声

声質変換は便宜的に音声変換と呼ばれる場合もあります。厳密には、声質変換や話者変換、感情変換などを総称する用語が音声変換です。

クロスリンガル声質変換とは

機械学習による声質変換では、変換先の話者(ターゲット話者)の音声を学習データとして用いることが一般的です。そのため多くの声質変換システムでは、ターゲット話者の喋る言語と同じ言語の音声しか変換することができません。 例えば日本語音声を変換する場合、ターゲット話者が日本語で喋る音声が必要となります。この音声変換システムに英語音声を入力しても上手く変換できません。以下に示す例は、日本語音声で学習した声質変換モデルに英語の音声を入力した場合の音声デモです。声質は変換できており、内容に関しても比較して聞くと似てはいますが、入力音声に含まれた内容の情報が変換先に十分反映されておらず、このままでは声質変換を用いて情報伝達することは不可能です。

ターゲット話者の音声(from JSUT[5])]

入力音声(from Voice Conversion Challenge 2020 database , which is made available here under the Open Database License (ODbL).)

変換した音声

これに対しクロスリンガル声質変換とは、入力音声の言語と学習に用いるターゲット話者の音声の言語が異なる場合でも変換が可能である声質変換です。

クロスリンガル声質変換の応用先として、ゲームやアニメを海外展開する際に必要となる、キャラクターの音声データの翻訳があります。言語ごとに異なる声優さんに依頼して音声を収録することが一般的ですが、言語ごとに微妙に声質が異なってしまうことや、キャラクターに合っていて、かつ外国語を流暢に話せる声優さんの発見が困難であるという課題があります。高品質なクロスリンガル声質変換が実現できれば、どの言語でも同じ声質で喋らせることができる上に、声優さんを探す際に声質を考慮する必要がなくなります。

事前学習済みモデルを利用したクロスリンガル声質変換の仕組み

今回のインターンでは、DeNAの声質変換システム[1]のクロスリンガル化を目的に、クロスリンガル声質変換の研究開発に取り組みました。

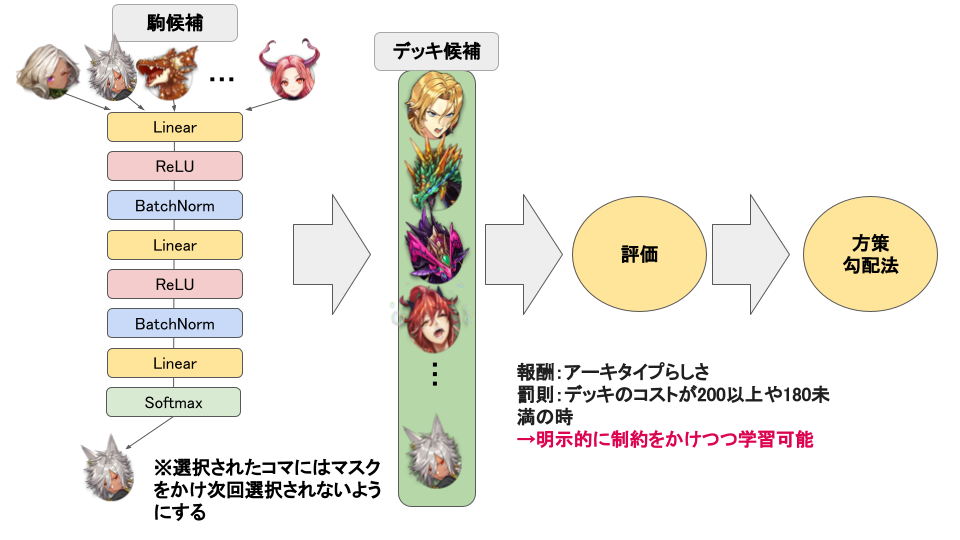

DeNAの声質変換システムは、はじめに入力音声から音素認識モデルで音素表現を抽出し、次に音声生成モデルで音素表現からターゲット話者の音声を合成する、という仕組みで動作します。クロスリンガル化にあたっては、元々使用していた音素表現が日本語にしか対応していないため、多言語に対応する特徴量で代替する必要がありました。

そこで、代替先の特徴量としてwav2vec[2]の中間表現を用いる方法を検証しました。wav2vecは音声認識に有用な特徴量を抽出する事前学習モデルであり、大量の単一言語音声データで事前学習されています。wav2vecの特徴として、言語間の違いをある程度吸収して特徴量を抽出できる点があります。このことから、wav2vecの中間表現を用いることで声質変換システムをクロスリンガル化できるのではないかと考えました。

wav2vecをDeNAの声質変換システムに導入するには多くの作業が必要となります。そこで、ひとまずwav2vecを用いたクロスリンガル声質変換が可能であるかを検証するため、VCC2020[3]という音声変換のコンペティションで優秀な成績を収めたモデル[4]にwav2vecを導入し、声質変換の品質を確認しました。wav2vecを用いたシステムによる声質変換の様子は以下の通りです。

-

ターゲット話者の音声(from JSUT[5]、先述した予備検討と同じターゲット話者です)]

この声に変換することを目指します。

-

女性英語話者の音声(先述の予備検討と同じ話者)を変換する場合

-

入力音声(from Voice Conversion Challenge 2020 database , which is made available here under the Open Database License (ODbL).)

-

変換した音声

-

-

男性英語話者の音声を変換する場合

-

入力音声(男性英語話者) (from Voice Conversion Challenge 2020 database , which is made available here under the Open Database License (ODbL).)

-

変換した音声

-

多少ノイズはありますが、変換によってターゲット話者の声質をある程度再現できています。また、声質のみが変換されており、喋り方や内容が保存されていることがわかるかと思います。

これより、wav2vecを用いてクロスリンガル声質変換が実現できることがわかりました。しかしながら品質はまだ実用レベルには至っておらず、さらなる改善が必要であると考えています。

まとめ

本記事では、クロスリンガル声質変換システムへの事前学習モデルの応用について紹介しました。声質変換技術がさらに進化し、好きなキャラクターが好きな言語で喋ることができるようになれば、とても面白いと思いませんか? この記事を通じて、少しでも声質変換に興味を持っていただければ嬉しいです。

最後に

今回のインターンでは、音声チームをはじめとするDeNAの方々から様々なことを指導頂き、大きく成長することができたと感じています。とても楽しく貴重な経験をすることができました。改めて感謝申し上げます。

参考文献

[1]

理想の声を目指して 〜七声ニーナの音声変換技術からライブ配信応用へ〜

[2]

wav2vec: Unsupervised Pre-training for Speech Recognition

[3]

Voice Conversion Challenge 2020

[4]

Non-Parallel Voice Conversion with Autoregressive Conversion Model and Duration Adjustment

[5]

JSUT corpus

最後まで読んでいただき、ありがとうございます!

この記事をシェアしていただける方はこちらからお願いします。